21. Aug 2024

Lesedauer 3 Min.

Transformer-Modelle revolutionieren Musikempfehlungssysteme

KI für Musikempfehlungen

Eine neue Methode nutzt Transformer-Architekturen zur Verbesserung von Musikempfehlungen, indem sie das Nutzerverhalten in verschiedenen Kontexten besser versteht.

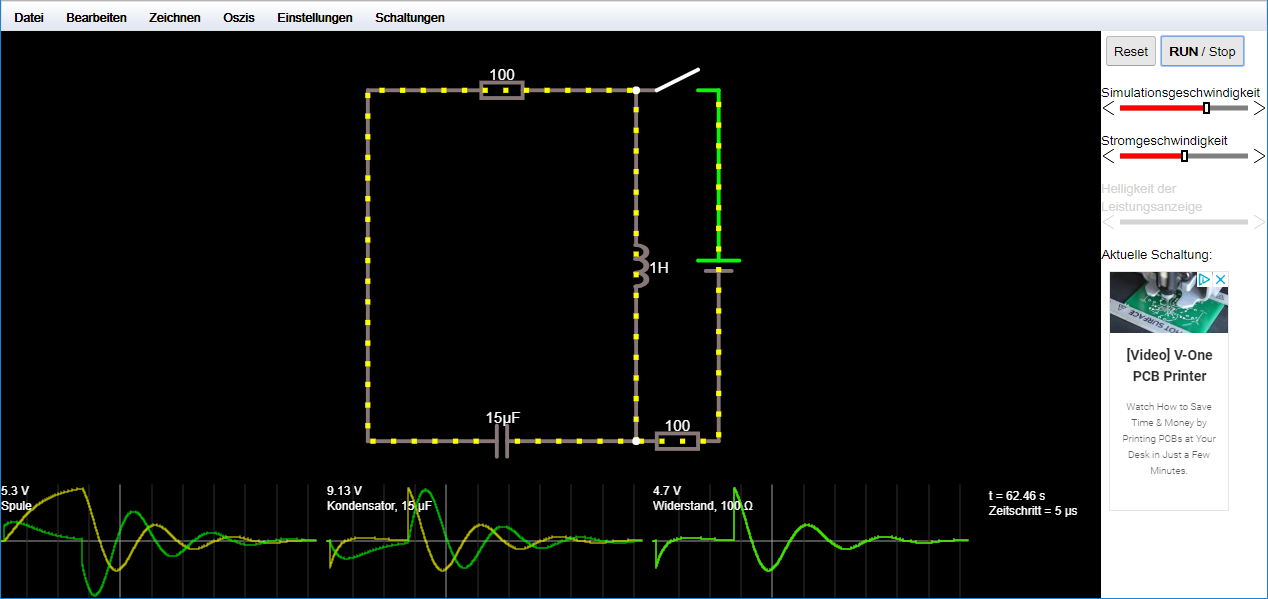

Mit über 100 Millionen Songs bietet YouTube Music seinen Nutzern eine enorme Auswahl. Die richtige Musikempfehlung ist daher nicht nur eine Herausforderung, sondern auch entscheidend für das Nutzererlebnis. Forscher bei Google haben eine neuartige Herangehensweise entwickelt, um die Empfehlungsgenauigkeit durch den Einsatz von Transformer-Modellen zu verbessern. Diese Modelle sind bekannt für ihre Fähigkeit, sequenzielle Daten zu verarbeiten und können das Nutzerverhalten in unterschiedlichen Kontexten verstehen.Ein Beispiel: Ein Nutzer mag langsame Songs. Ein schneller Titel würde ihm nicht so zusagen. Doch in einem anderen Kontext – wie beispielsweise beim Workout – bevorzugt der Nutzer energische Musik. Das Problem besteht nun darin, dass herkömmliche Systeme oft nicht in der Lage sind, diese kontextuellen Unterschiede zu erkennen und anzupassen. Das neu entwickelte Empfehlungssystem von Google nutzt Transformer-Modelle, um aus den vergangenen Nutzerinteraktionen und deren Kontext die besten Empfehlungen zu generieren. Die Architektur besteht aus drei Hauptphasen: der Auswahl relevanter Songs (Retrieval), der Bewertung dieser Songs (Ranking) sowie der Filterung der Vorschläge. Der innovative Ansatz verwendet die Transformer-Struktur, um nicht nur die vorangegangenen Interaktionen des Nutzers zu berücksichtigen, sondern auch deren jeweilige Bedeutung im aktuellen Kontext des Nutzers zu bewerten.Dies bedeutet konkret, dass das System aus den Reaktionen der Nutzer – sei es das ‚Gefällt mir‘, ‚Gefällt mir nicht‘ oder das ‚Überspringen‘ von Songs – lernt. Besondere Aufmerksamkeit wird dabei den aktuellen Aktionen geschenkt, um die Relevanz der Empfehlungen zu steigern. Beispielsweise wird im Fitnessstudio ein schnellerer Song, der normalerweise übersprungen wird, gezielt empfohlen, während in anderen Szenarien ältere Präferenzen stärker gewichtet werden.Vorläufige Tests zeigen, dass diese neue Methode die Absprungrate verringert und die Nutzungszeit erhöht, was auf eine höhere Zufriedenheit der Nutzer hindeutet.Weitere Informationen