OpenTelemetry als Fundament einer vertrauenswürdigen Observability-Infrastruktur

Cloud-Infrastrukturen sind heute das digitale Rückgrat von Behörden, Unternehmen und Organisationen – und damit auch ein attraktives Ziel für Angriffe und Missbrauch. Wer moderne Systeme betreibt, muss nicht nur für Leistung und Verfügbarkeit sorgen, sondern auch für Kontrolle, Nachvollziehbarkeit und Sicherheit. Dabei ist die Grundlage jeder Entscheidung eine verlässliche Datenbasis: präzise, vollständig und strukturiert erfassbar. Genau hier kommt OpenTelemetry ins Spiel – ein offener Standard, der sich zunehmend als technische Basis für Observability durchsetzt.

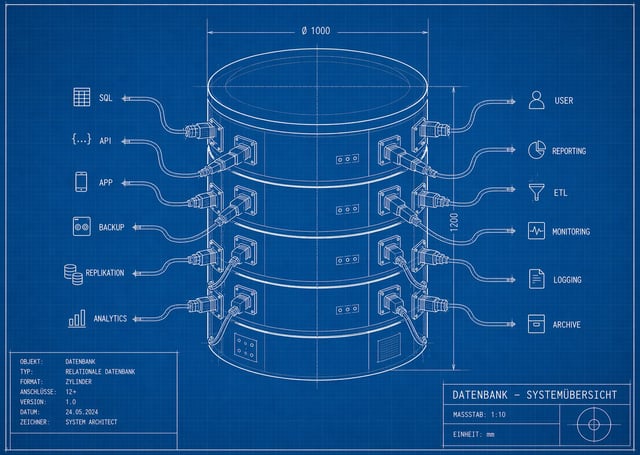

OpenTelemetry ermöglicht es, Metriken, Logs und Traces aus unterschiedlichsten Systemen konsistent zu erfassen, unabhängig von Sprache, Anbieter oder Infrastruktur. Das schafft eine gemeinsame Sprache für Betriebsdaten, die besonders in hybriden oder stark regulierten Umgebungen essenziell ist. Denn Transparenz ist keine Option mehr, sondern Voraussetzung für sichere, auditierbare und steuerbare IT-Prozesse.

Insbesondere im Hinblick auf Sicherheitsanforderungen ist die Offenheit von OpenTelemetry ein zentraler Vorteil. Statt auf abgeschottete Monitoring-Tools mit proprietären Formaten angewiesen zu sein, lassen sich mit OpenTelemetry standardisierte Datenpfade etablieren. Sie dienen als Grundlage für nachvollziehbares Security-Monitoring, sowohl im Tagesbetrieb als auch im Fall forensischer Analysen. So entsteht ein verlässliches Fundament für Transparenz, das technologische Offenheit mit operativer Sicherheit verbindet.

Vom Datenstrom zum Systemverständnis

Doch mit der bloßen Erfassung ist wenig gewonnen. Erst wenn Telemetriedaten intelligent analysiert und in Zusammenhang gestellt werden, entsteht ein vollständiges Lagebild. Das betrifft nicht nur Performance oder Verfügbarkeit, sondern erfasst vermehrt auch sicherheitsrelevante Zusammenhänge innerhalb der Systemarchitektur. Wo treten ungewöhnliche Zugriffsmuster auf? Welche Services interagieren unerwartet miteinander? Wurden in einer bestimmten Umgebung neue Konfigurationsdateien geladen?

Moderne Observability-Plattformen übernehmen hier die Aufgabe, Signale zu verknüpfen, Systemtopologien zu verstehen und Muster in Echtzeit zu erkennen. Dadurch werden Zusammenhänge sichtbar, die mit klassischen Monitoring-Lösungen oft verborgen bleiben. Ein einzelner Logeintrag oder ein auffälliger Metrikwert erhält erst dann Bedeutung, wenn er in Beziehung zu Traces, Deployments oder User-Verhalten gesetzt wird.

Gerade in sicherheitsrelevanten Systemlandschaften ist diese Fähigkeit zentral. Sie ermöglicht es, verdeckte Risiken zu erkennen, operative Unregelmäßigkeiten zu bewerten und technische Schwachstellen nicht nur zu vermuten, sondern nachzuweisen. Das reduziert die Reaktionszeit im Ernstfall und stärkt zugleich die strategische Fähigkeit, Systeme resilient und kontrollierbar zu betreiben.

Causal AI im Dienst der Ursachenanalyse

Mit wachsender Systemkomplexität steigen auch die Anforderungen an die Analyse. Die manuelle Rekonstruktion von Ursache-Wirkungs-Zusammenhängen gerät schnell zur Überforderung – vor allem im Kontext sicherheitsrelevanter Zwischenfälle, bei denen schnelle Ursachenklärung gefragt ist. Hier setzt Causal AI an: ein Analyseansatz, der nicht nur Muster erkennt, sondern gezielt nach den zugrunde liegenden Auslösern sucht.

Causal AI unterscheidet sich von herkömmlicher Künstlicher Intelligenz vor allem durch die Nachvollziehbarkeit ihrer Ergebnisse. Sie analysiert nicht nur Korrelationen, sondern rekonstruiert kausale Zusammenhänge. In einigen Szenarien ist das besonders entscheidend – etwa zur präzisen Rekonstruktion eines Datenlecks oder zur forensischen Aufarbeitung einer kompromittierenden Systemaktivität.

Die Bedeutung dieser Technologie zeigt sich auch in der Praxis: Statt pauschale Alarmmeldungen zu erzeugen, liefert Causal AI konkrete, priorisierte Ursachenketten. So lässt sich etwa nachvollziehen, dass ein Konfigurationsfehler in einer spezifischen Build-Umgebung zu einer Eskalation im Zugriffssystem geführt hat, verbunden mit klaren Zeitstempeln, Systempfaden und Benutzerinteraktionen. Für Sicherheitsteams bedeutet das: weniger Aufwand bei der Ursachenanalyse, höhere Verlässlichkeit in der Bewertung und eine bessere Grundlage für Berichte, Audits und Reaktionen.

Von reaktiv zu präventiv

Sicherheitsarbeit beginnt heute nicht mehr mit dem Alarm, sondern mit der systematischen Vermeidung von Risiken. Wer erst reagiert, wenn der Schaden bereits entstanden ist, handelt zu spät. Präventive Sicherheit erfordert die Fähigkeit, Anomalien frühzeitig zu erkennen, Risiken automatisch zu bewerten und proaktiv gegenzusteuern. AI-gestützte Observability-Plattformen liefern dafür die technische Grundlage.

Wenn Telemetriedaten nicht nur gesammelt, sondern kontinuierlich analysiert und bewertet werden, entsteht ein Frühwarnsystem, das sowohl technische als auch sicherheitsbezogene Abweichungen zuverlässig erkennt. Beispielsweise kann eine Plattform registrieren, dass ein bestimmter Authentifizierungsmechanismus in mehreren Regionen ungewöhnlich oft scheitert – ein potenzieller Hinweis auf ein Brute-Force-Szenario. Oder sie stellt fest, dass sich die Latenz eines internen Service in Verbindung mit einer neuen Container-Version signifikant verändert, mit möglichen Auswirkungen auf die Zugriffssteuerung.

Der entscheidende Fortschritt liegt jedoch nicht nur in der Erkennung, sondern in der Handlungsfähigkeit: Moderne Systeme liefern konkrete Empfehlungen für Gegenmaßnahmen, basierend auf bekannten Mustern und kontextuellen Bewertungen. Diese Vorschläge lassen sich in automatisierte Reaktionspfade integrieren – von der Priorisierung über das Alert-Routing bis hin zur Umsetzung durch integrierte Workflows. Damit wird Sicherheit nicht zur Reaktion, sondern zum kontinuierlich lernenden System.

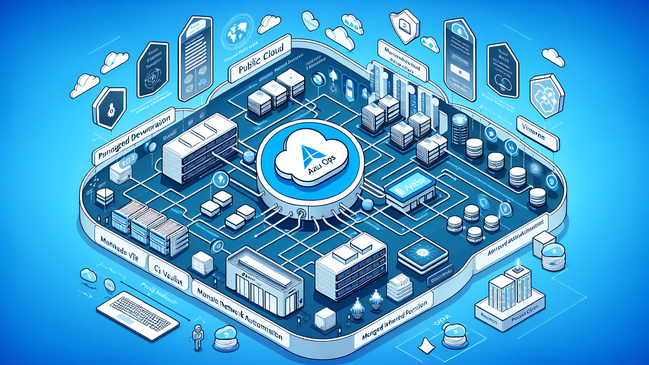

Offenheit trifft Automatisierung – auch in der Security

Der zentrale Gewinn liegt in der Verbindung von Offenheit und Automatisierung. OpenTelemetry liefert die Grundlage für eine einheitliche Datenerhebung, moderne DevOps-Prozesse schaffen die Flexibilität für dynamische Infrastrukturen – und intelligente Plattformen übersetzen diese Daten in belastbare Entscheidungen. Für Sicherheitsverantwortliche entsteht daraus eine Infrastruktur, die Transparenz, Kontrolle und Reaktion in einem integrierten Prozess vereint.

Gerade in verteilten oder regulierten Umgebungen zeigt sich der Vorteil eines solchen Ansatzes: Statt mühsam Informationen aus Einzelsystemen zusammenzutragen, liegt ein vollständiges, strukturiertes und jederzeit nachvollziehbares Bild vor – für Audits ebenso wie für den operativen Alltag. Das reduziert die Fehleranfälligkeit, entlastet Personalressourcen und erhöht die Fähigkeit, auch unter Druck sicherheitsrelevante Entscheidungen zu treffen.

Die klassische Trennung zwischen Security, Operations und Development wird dadurch zunehmend obsolet. Statt in isolierten Fachdisziplinen zu arbeiten, greifen Prozesse, Daten und Verantwortlichkeiten ineinander. Und genau darin liegt der eigentliche Fortschritt: Observability wird zum Bindeglied zwischen Technologie und Sicherheit, zwischen Erkennen und Handeln, zwischen operativer Realität und strategischer Steuerung.