Mit Entitäten strukturierte Informationen extrahieren

Low Code/No Code und KI mit Copilot Studio, Teil 2

Eine Entität in Copilot Studio ist ein benannter Datentyp oder ein Erkennungsschema (vordefinierte Typen wie Datum, Zahl, Liste oder Regex-Muster) zur Erkennung und Extraktion von Werten in Nutzereingaben. Copilot Studio speichert die erkannten Werte in Variablen und stellt sie dem Agenten bereit. Noch fehlende erforderliche Werte werden durch gezielte Rückfragen erhoben. Entitäten kommen in Fragen, Bedingungen, Variablen und bei der Parameterübergabe an Aktionen zum Einsatz. GenAI nutzt diese strukturierten Werte als Kontext für konsistentere Antworten; eine Eingrenzung erfolgt über Dialoglogik und Aktionsparameter.

Copilot Studio kennt verschiedene Klassen von Entitäten

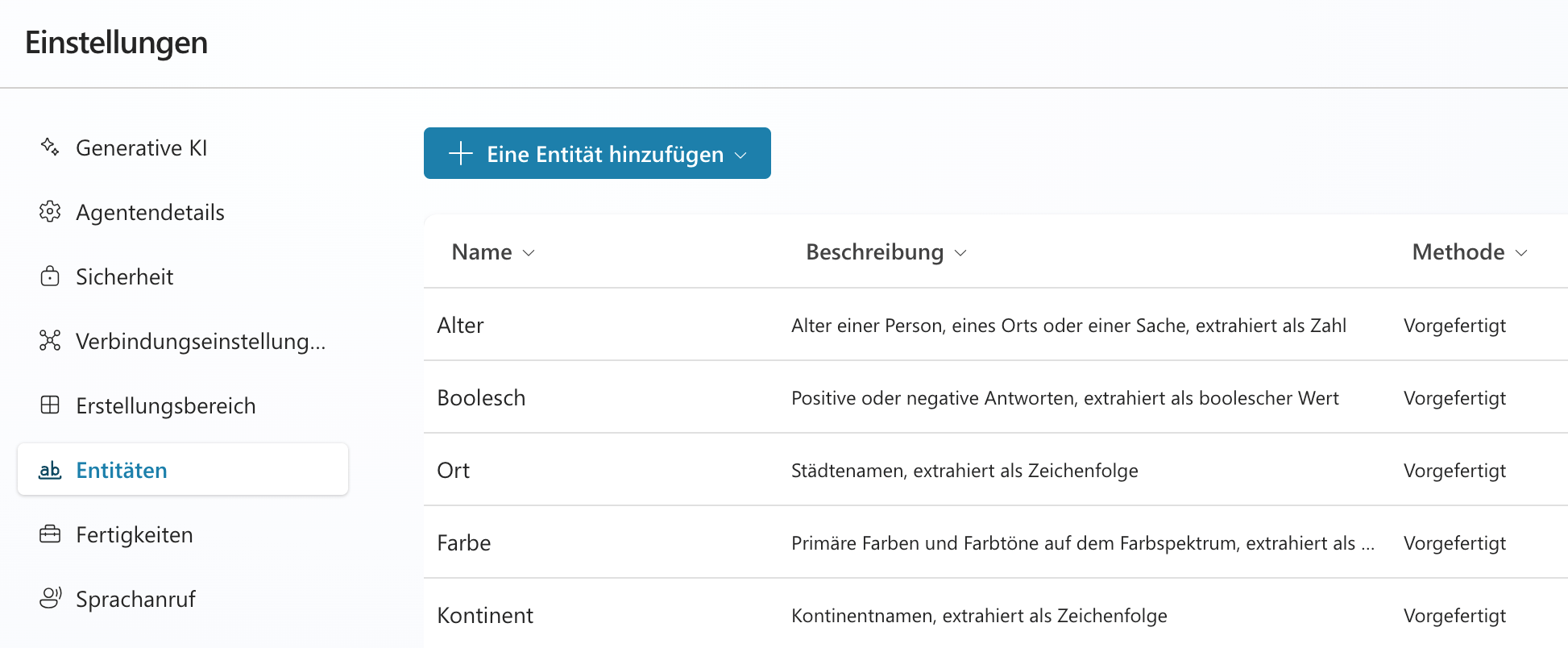

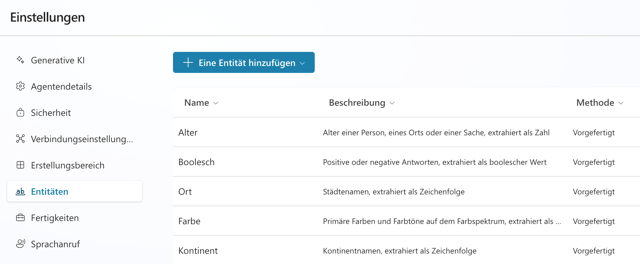

Copilot Studio stellt vordefinierte Entitäten (Prebuilt Entities) bereit, um häufige Informationstypen abzudecken. Sie erkennen Werte in Benutzereingaben und speichern diese in Variablen eines passenden Basistyps (Zahl, Zeichenfolge, Datum, Zeit); beispielsweise wird ein erkannter Geldbetrag als Zahl abgelegt. Welche Prebuilt‑Entitäten verfügbar sind, hängt primär von der gewählten Sprache beziehungsweise Lokalisierung des Agenten ab. Bei den Einstellungen (Settings) eines Agenten lassen sich die verfügbaren Prebuilt-Entitäten erkunden und bei Bedarf um Custom Entities (benutzerdefinierte Entitäten) ergänzen (Bild 1).

Microsoft stellt Prebuilt-Entitäten bereit und verwaltet sie; der Entwickler kann diese nicht direkt bearbeiten oder ändern (Bild 1)

AutorCopilot Studio teilt die vorhandenen Prebuilt-Entitäten in Typen oder Gruppen ein:

- Zeit und Datum: Erkennt Uhrzeit- und Datumsangaben wie Date, DateTime, Duration, Time.

- Zahlen und Maße: Dabei handelt es sich um Zahlen, numerische Werte und Währungsbeträge – dazu gehören Number, Money, Percentage, Ordinal (zum Beispiel Rangfolge: dritte, letzte).

- Kontakt und Identifikation: Umfasst E-Mail-Adresse, Telefonnummer, URL, IP-Adresse.

- Orte und Adressen: Dazu zählen Länder, Städte, Adressen – City, Country/Region, gegebenenfalls Postleitzahl abhängig von der Sprache.

- Person und Organisation: für Namen einer Person, einer Organisation oder eines Arbeitsplatzes.

- Farben: Color.

Weitere häufige Typen je nach Sprache beziehungsweise Lokalisierung stellen zum Beispiel Temperatur oder Maße/Dimensionen dar. Medien und Dateien werden nicht als Entitäten, sondern über Upload‑Funktionen, Aktionen oder Konnektoren behandelt. Bei aktivierter generativer Orchestrierung erfragt der Agent fehlende Eingaben automatisch und extrahiert kontextabhängig Werte.

Eigene, benutzerdefinierte Entitäten erstellen und konfigurieren

In den Einstellungen eines Agenten befindet sich der Eintrag Entitäten, dort erstellt oder ändert der Entwickler benutzerdefinierte Entitäten (Custom Entities). Die Neuanlage erfolgt über die Schaltfläche + Eine Entität hinzufügen und Auswahl von Neue Entität. Dabei bietet Copilot Studio zwei Typen an: Geschlossene Liste (Closed List) für Kategorien und Synonyme sowie Regulärer Ausdruck (Regex) für formal strukturierte Muster wie Kundennummern oder Vertrags-IDs. Da der verwendete Regex-Dialekt nicht .NET-spezifisch dokumentiert ist, sollten deren Muster getestet werden.

Fortgeschrittene Typen wie Composite, Lookup-Entitäten oder ML-gestützte Entitäten sind in Copilot Studio derzeit selbst nicht verfügbar, lassen sich aber bei der Neuanlage durch Auswahl des zweiten Menüeintrags + Externe Entität registrieren und in den Agenten einbinden. Entitäten sollten klar abgegrenzt und präzise benannt werden: kurz, eindeutig und neutral (zum Beispiel Kundennummer statt Kundeninfo). Auf eine einheitliche Namensgebung und Wiederverwendbarkeit ist zu achten. Überschneidungen durch ähnliche Begriffe sollten vermieden und nicht zu viele Synonyme definiert werden – eine überschaubare, repräsentative Menge reicht aus, da zu viele Varianten die Erkennung erschweren.

Regex‑Entitäten erkennen formal strukturierte Muster zuverlässig und ermöglichen so eine deterministische, regelbasierte Extraktion: Sie sind sinnvoll, wenn ein Wert eindeutig formatiert ist und nicht semantisch interpretiert werden soll; sie dienen primär der Genauigkeit und Validierung. Regex‑Entitäten verbessern nicht die Performance der KI-Verarbeitung und dienen auch nicht als Maßnahme zur Beschleunigung der Ausführung des Agenten, was ein verbreitetes Missverständnis darstellt. Vielmehr sind Regex‑Entitäten ein Werkzeug zur präzisen und kontrollierten Extraktion.

Entity-Extraktion als zentraler Bestandteil der Sprachverarbeitung

Die Kommunikation zwischen dem Benutzer und dem Agenten findet primär in natürlicher Sprache statt. Ziel der Sprachverarbeitung ist die Erkennung von Absichten (Intents) und die Extraktion von Entitäten. Diese Erkennung von Intents und die Extraktion von Entitäten (Entity Extraction) erfolgt mittels NLU (Natural Language Understanding)/CLU (Conversational Language Understanding). Dabei erkennt der Agent aus dem Nutzerinput spezifische Informationen und speichert sie in Variablen, die mit vorgefertigten (prebuilt) oder benutzerdefinierten Entitätstypen verknüpft sind.

Unter Umständen kommt Slot‑Füllung (Slot Filling) zum Einsatz: Der Agent stellt dabei gezielte Fragen, um fehlende Werte für definierte Entitäten zu erfassen, falls sie nicht im Input enthalten sind. Die Entitätserkennung ist ein wesentlicher Baustein, der Copilot Studio hilft, Nutzeräußerungen strukturiert auszuwerten und in Themen gezielt auf die enthaltenen Informationen zu reagieren. Standardmäßig interpretiert Copilot Studio Eingaben über generative Orchestrierung mittels des LLM (Large Language Model). Optional kann ein CLU‑Modell (Conversational Language Understanding) aus Azure AI Language integriert werden.

CLU ist ein Azure-AI-Language‑Dienst, der als NLU‑Komponente (Natural Language Understanding) die Absicht eines Nutzerbeitrags erkennt und relevante Entitäten extrahiert; er steuert jedoch keinen Dialog selbst. Für CLU wird der Agent auf klassische Orchestrierung umgestellt. Bei aktivierter CLU‑Integration werden Absichten Themen zugeordnet und Entitäten im Agenten genutzt; zusätzlich wird ein Systemthema wie Text analysieren erstellt, das Absichten und Entitäten in der Unterhaltung erkennt. Slot‑Füllung, die Auflösung von Mehrdeutigkeiten und die Verwaltung des Gesprächszustands werden vom Agenten orchestriert (zum Beispiel über Frageknoten, Entitäten und Systemvariablen).

Microsoft hat die klassische Orchestrierung (NLU, NLU+, CLU) um generative KI (GenAI) ergänzt. In Copilot Studio ist GenAI jetzt die Standardoption, sie orchestriert die Unterhaltung, indem sie die passende Kombination aus Aktionen, Themen und Wissensquellen auswählt. Neuere Agent-Designs nutzen diese generative Orchestrierung zusätzlich zur klassischen NLU/CLU. Die Entitätserkennung dient weiterhin der Extraktion strukturierter Werte; erkannte Informationen werden in Variablen gespeichert, die entsprechenden Entitätstypen zugeordnet sind. Generative Modelle erweitern damit die Möglichkeiten bei Themenauswahl und Interpretation, ersetzen die klassische Intent‑/Entitätserkennung jedoch nicht.

Entitäten als Steuerungsdaten in Dialogen und Automatisierung nutzen

Nach dem Anlegen und Speichern einer benutzerdefinierten Entität steht diese in Copilot Studio in allen relevanten Bereichen zur Verfügung, zum Beispiel im Fragenknoten (Identify) zur Erfassung von Werten. Entitäten und die aus ihnen gewonnenen Werte werden dort eingesetzt, wo strukturierte Daten benötigt werden. In der klassischen Orchestrierung (NLU/NLU+/CLU) können Entitäten in Trigger-Ausdrücken annotiert werden, um die Erkennung zu verbessern. Die Themenauswahl erfolgt jedoch über Trigger-Ausdrücke beziehungsweise generativ über LLM-basiertes Topic-Routing und nicht allein durch das Vorkommen eines Entitätswerts.

Wird eine Entität in einer Frage verwendet, extrahiert Copilot Studio den passenden Wert automatisch aus der Antwort des Nutzers (Slot‑Füllung) und speichert ihn in der zugehörigen Variablen. Für die Steuerung des Gesprächsflusses können diese Variablen in Bedingungen eingesetzt werden, um dialogabhängig zu verzweigen. Werden Variablen verwendet, deren Basistyp eine Entität ist, strukturieren sie den Kontext, ermöglichen Personalisierung und helfen der generativen Orchestrierung, Inhalte konsistent und domänenspezifisch aufzubereiten.

Automatisierungen profitieren ebenfalls von Entitätswerten: Diese können als Parameter an Power-Automate‑Flows und Connector-/Aktionsaufrufe übergeben oder in Power-Fx‑Ausdrücken weiterverarbeitet werden. So lassen sich zum Beispiel Suchparameter präzisieren oder die Auswahl von Dokumenten in Power-Automate-Flows gezielt steuern. Werte aus Entitäten werden in Variablen gespeichert, die lokal (themenspezifisch) oder als globale Variablen geführt und wiederverwendet werden können.

Testen der Entitätserkennung, Slot-Füllung und Variablenverarbeitung sind zentral für Fehlersuche und Fine-Tuning. Mit der Ausführung eines Agenten öffnet sich automatisch das Test Panel im Fensterausschnitt Ihren Agenten testen, und eine Testsitzung startet. Um die bisherige Testsitzung zu beenden, genügt ein Klick auf das kleine Plus (+)-Icon, und eine neue Testsitzung startet. Für die Ausführung eines Testfalls gibt der Tester eine Frage- oder Problemstellung in das untere Eingabefeld ein.

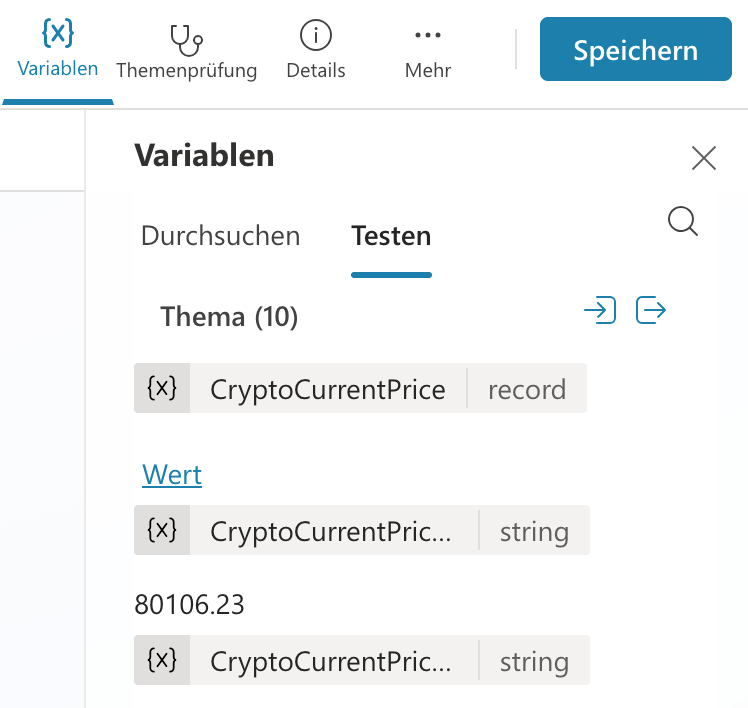

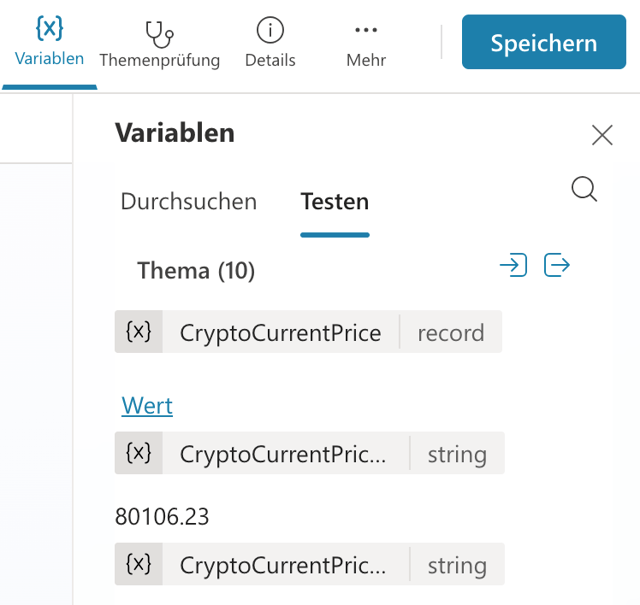

Zur Analyse des Testverlaufs nutzt der Tester die Schieberegler Aktivitätszuordnung beim Testen anzeigen oder die Nachverfolgung der Themenverläufe, um die Schritte nachzuvollziehen – beide sind über das …-Menü in der Toolbar zu erreichen. Ein Klick in dieser Toolbar auf den Eintrag {x} öffnet das Dialogfenster Variablen mit den beiden Registerkarten Durchsuchen und Testen (Bild 2), um aktuelle Variablenwerte – einschließlich aus Entitäten extrahierter Werte – zu prüfen und deren Verarbeitung zu kontrollieren.

Die Ausführung geeigneter Testfälle in Konversationen prüft Entitätserkennung, Slot-Füllung und die Verarbeitung der Variablen und ihrer Werte (Bild 2)

AutorThemen/Topics, Trigger und Entitäten mit GenAI

Ein mit Copilot Studio entwickelter Agent sollte nicht nur verstehen, was ein Benutzer schreibt, sondern auch, welches Ziel dahintersteht.

In der klassischen Orchestrierung werden Absichten über Themen mit Trigger-Ausdrücken modelliert; anhand der Benutzereingabe wählt der Agent das passende Thema aus. Entitäten dienen der Extraktion strukturierter Informationen und werden per Slot‑Füllung in Variablen gespeichert; sie entscheiden nicht über die Themenauswahl.

Moderne Agenten können zusätzlich generative Orchestrierung nutzen, die automatisch die geeignete Kombination aus Themen, Tools und Wissensquellen auswählt. Der Intent‑Begriff bleibt in klassischen NLU‑Optionen (NLU, NLU+, gegebenenfalls CLU) relevant und wird durch generative Orchestrierung nicht ersetzt.

Je nach Szenario arbeiten Agenten mit expliziten Trigger-Ausdrücken oder mit generativer Orchestrierung – beide Ansätze werden unterstützt.